NeurIPS2018时间检验奖论文回顾:为什么深度学习适合大规模数据集

雷锋网 AI 科技评论按:NeurIPS 2018 于 12 月 3 日至 12 月 8 日在加拿大蒙特利尔会展中心举办。大会第一天下午颁布了各项论文奖,其中包括时间检验奖(Test of Time Award),获奖论文是《The Trade-Offs of Large Scale Learning》。

这篇论文是机器学习界、尤其是深度学习发展道路上的一篇重要论文,也可以说是推动研究人员们不断建立并使用更大的数据集的理念来源之一。谷歌 AI 苏黎世研究院项目经理、丹麦科技大学教授 Anna Ukhanova 撰文解析了这篇论文的内容以及它对整个机器学习界的后续影响。雷锋网 AI 科技评论编译如下。

机器学习界的学术研究进展飞快,仿佛任何一种新点子、新想法只要一两年就显得过时了,或者是被别的东西取代了。不过,即便是许多研究者们后来已经不再关注的区域里,也有一些老想法持续地体现出自己的重要性。这种状况之所以会发生是因为不同的语境:在某个研究方向里看起来死路一条的想法在另一个研究方向里则可能会变得非常成功。而对于深度学习这个具体的例子来说,可获得的数据以及可利用的计算资源的大幅增长不断为这个领域注入了新鲜的活力和注意力,也对研究方向的选择产生了显著影响。

当年发表在 NIPS 2007 会议的论文《The Trade-Offs of Large Scale Learning》就是这种现象的见证者。这篇来自 Léon Bottou (当时在 NEC 实验室,现在在 Facebook 人工智能研究院 FAIR)和 Olivier Bousquet(谷歌 AI 苏黎世研究院)的论文获得了今年 NeurIPS 的时间检验奖,论文内容是研究机器学习领域内数据和计算能力之间是如何相互作用的;他们的结果表明,在计算能力有限、但可以使用一个大规模数据集的情况下,面对「A,使用尽量多的训练样本,但每个样本只进行较少的计算」,和「B,取一小部分数据进行高强度的计算」两种选择,前一种做法的效率更高。他们的研究对象是一种较老的算法,随机梯度下降(SGD),而它如今几乎也和所有的深度学习应用形影不离。

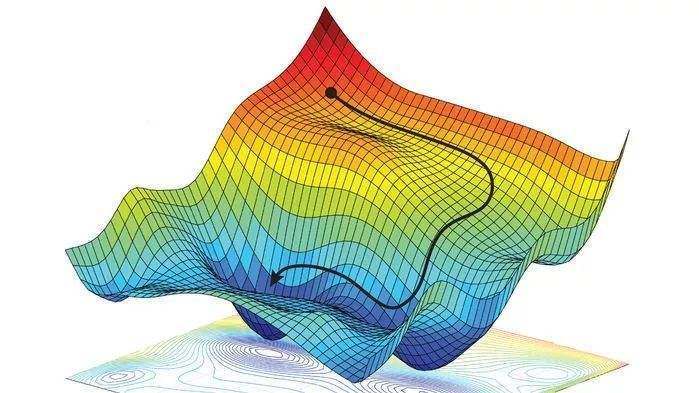

梯度下降示意图优化方法,以及大规模数据带来的挑战

许多机器学习算法都可以看作两种因子的组合:

一个模型,它可以由许多种不同的函数组合而成,可以用来拟合数据

一个优化算法,它可以具体描述出如何选择出效果最佳的那个函数

1990 年代的时候,机器学习研究者们使用的数据集要比现在的小多了,而且当时他们也认为人工神经网络很难训练,即便当时它们已经展现出了一些成果。到了 21 世纪初,随着核方法(kernel machines),尤其是支持向量机(SVM)的出现,人们对神经网络的热情迅速消失殆尽。与此同时,本来研究优化算法的研究者们也把注意力从研究神经网络的优化算法(随机梯度下降)转移到了研究核方法的优化算法上(二次规划法,quadratic programming)。这两种优化方法之间的区别在于,对于随机梯度下降,每次计算只使用一个训练样本用来计算梯度步骤(称之为「随机」);而对于核方法的优化算法,每一次迭代中都需要使用所有的训练样本(称之为「批量」)。

SVM 示意图

但随着训练数据集的大小变得越来越大,优化算法处理大规模数据的效率就成为了瓶颈。比如对于二次规划法,算法的运行时间最少也要和训练样本的数量的平方成正比,也就是说,如果你的训练数据变成了原来的 2 倍,那么训练时间至少也会变成原来的 4 倍。所以研究人员们也花了很多精力尝试如何让这些算法更好地拓展到大规模数据集上。

曾经训练过人工神经网络的研究人员们则深深知道把随机梯度下降拓展到大规模数据集上会容易很多,只不过它的问题在于它的收敛很慢(想要达到和批量算法相同的准确率,随机方法需要的迭代次数要多很多),所以那时候大家也并不能清晰地判断出它是否会是解决数据规模问题的那个黄金方案。

随机方法有更好的可拓展性

在机器学习领域里,优化损失函数所需的迭代次数其实并不是最让人头疼的那个问题,毕竟一直调节模型、调节得到完美的损失函数,其实是过拟合到了训练数据上。所以为什么不省下调节模型花费的计算能力,而用这些计算能力处理更多的数据呢?

版权保护: 本文由 沃派博客-沃派网 编辑,转载请保留链接: http://www.bdice.cn/html/11798.html