微软小冰首席科学家武威解读 EMNLP 论文:聊天机器人的深度学习模型

原标题:微软小冰首席科学家武威解读 EMNLP 论文:聊天机器人的深度学习模型

雷锋网 AI 科技评论按:2018 年度 EMNLP 大会上,微软小冰首席科学家武威和北京大学助理教授严睿就聊天机器人近年来的研究成果作了全面总结,并对未来聊天机器人的研究趋势进行了展望。

近日,在雷锋网 AI 研习社公开课上,微软小冰首席科学家武威就为大家带来了其在 EMNLP 大会上分享的精华部分。公开课回放视频网址:

?=wuwei

分享嘉宾:

武威,微软小冰首席科学家,主要研究方向为自然人机对话、自然语言处理、机器学习以及信息检索;为微软小冰第二代到第六代对话引擎贡献了核心算法,并带领团队研发了第五代小冰的生成模型以及第六代小冰的共感模型。

分享主题:聊天机器人的深度学习模型

分享提纲:

1. 引言

2. 深度学习基本概念

3. 基于检索的聊天机器人

4. 基于生成式的聊天机器人

5. 未来趋势和结论

雷锋网 AI 研习社将其分享内容整理如下:

引言

本次公开课主要分享我和北京大学的严睿老师在 2018 年度 EMNLP 大会上做 tutorial 分享的精华内容。

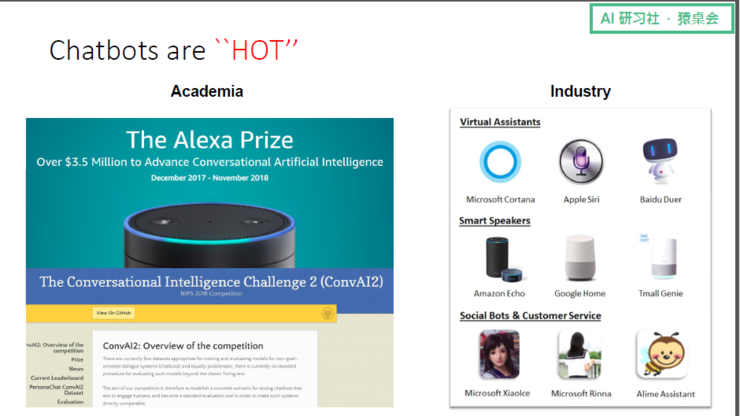

最近聊天机器人很火。我进行了一个小实验,在 google scholar 的 advanced search 以「聊天机器人」为关键词搜索文章——要求文章的题目必须包含「chatbot」这个单词,经过统计,发现从 2015-2017 年,标题包含「chatbot」这个单词的文章数量呈指数型增长。当然,这个实验是不全面的,一些标题包含「conversation model」的文章虽然标题中没有「chatbot」,但是也是关于「chatbot」的文章。因此,我们可以想象得到它在学术界的火热程度。

另外在工业界,亚马逊和 Facebook 都举办了一些比赛,例如亚马逊就举办了两届 The Alexa Prize,而 Facebook 也在 NIPS 上举办了两次关于 chatbot 的比赛,这些比赛都受到了很多人的关注。同时,大公司基本上都有自己的聊天机器人产品,例如微软有小冰,苹果有 Siri 等等。

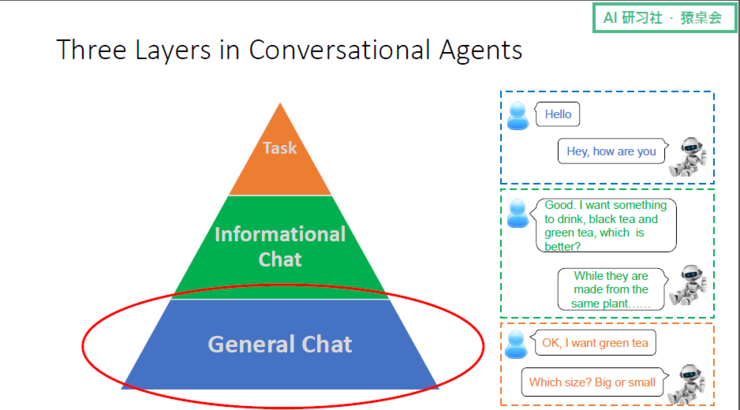

我们认为构建聊天机器人引擎有三层:

最底层的是 General Chat;

再上一层是 Informational Chat,涉及到人和机器人进行信息交换、机器人为人提供一些信息,比如问答;

最上面一层是 Task,即机器人通过对话的方式帮助人完成一些任务。

这里我举一个例子:

(关于该案例的具体讲解,请回看视频 00: 03:20 处)

今天我们主要讲 General Chat,这就要提到微软小冰在整个业界所产生的影响力。小冰 2014 年在中国发布,之后便以一年落地一个国家的节奏,先后在日本、美国、印度以及印度尼西亚发布。现在,它在全球拥有 6 亿+用户,产生的对话数量超过 3 百亿。

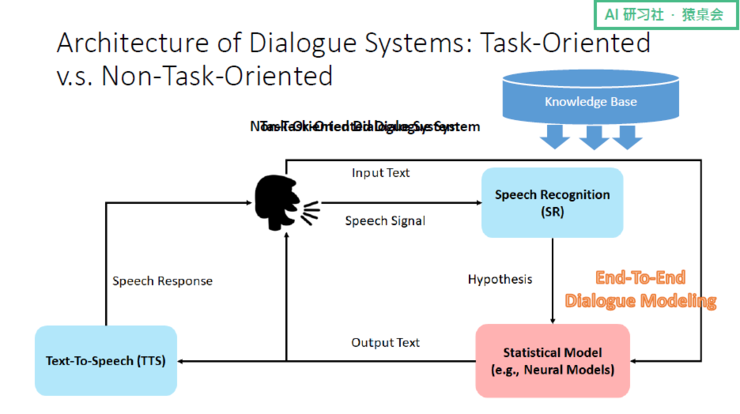

小冰背后最核心的部分就是对话引擎。传统的对话引擎是基于任务导向的,它分为以下几个模块:

第一个是人与机器产生对话后的语音识别模块;

第二个是语言理解模块,该模块对谈话的意图、话题等进行分析;

第三个是对话管理模块,语言理解模块产生的分析输入到对话管理模块后,该模块根据语言理解模块的理解产生一个决策,决定机器人下一步采取怎样的行为;

第四个是语言生成模块,该模块根据所有的信息合成出一个回复,并将回复传送到 TTS 这个模块中,最终变成语言返还给用户。

当然整个过程中也需要跟 Knowledge base 进行互动:如果用户提供的信息充分,对话引擎则需要从 Knowledge base 中为用户找出答案;如果不充分,则需要向用户再次发问获得更多信息。

随着大数据时代的到来和深度学习技术的发展,对话引擎也发生了改变:语言理解、对话管理以及语言生成模块简化成统计模型,可支持端到端的训练。这个统计模型就是我们今天重点介绍的内容。

构建非任务导向或者说 General Chat 的对话引擎,现在学术界或业界一般有两种基本的方法:

第一种是基于检索的方法:用户进行输入后,系统通过查询 index,找到所有可能的回复并从中选出最合适的回复返回给用户;

第二种是基于生成式的方法:用户进行输入后,系统通过机器学习的办法合成出一个回复并返回给用户。

不管哪种方法,神经网络都在其中起到了非常重要的作用。

深度学习基本概念

在介绍这两种方法之前,我先给大家简单介绍一下深度学习在 NLP 中的一些基本知识。

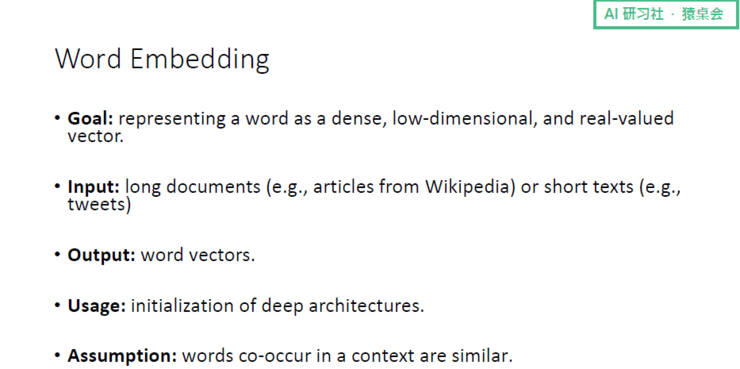

Word Embedding:深度学习在 NLP 中应用的基石。

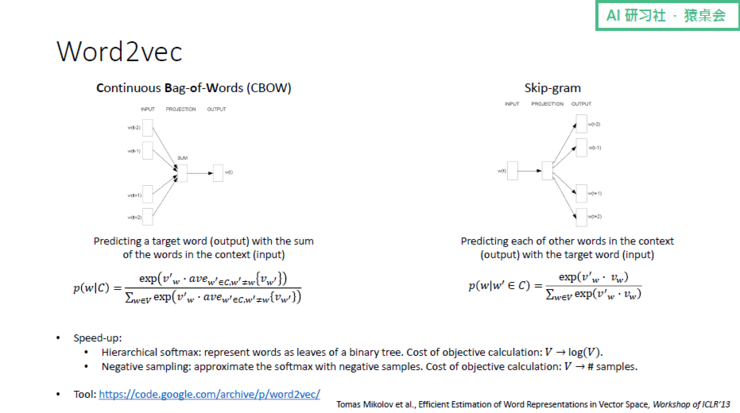

Word Embedding 最经典的方法就是 Word2vec,它有两个模型:

第一个是 Continuous Bag-of-Words(CBOW)

第二个是 Skip-gram

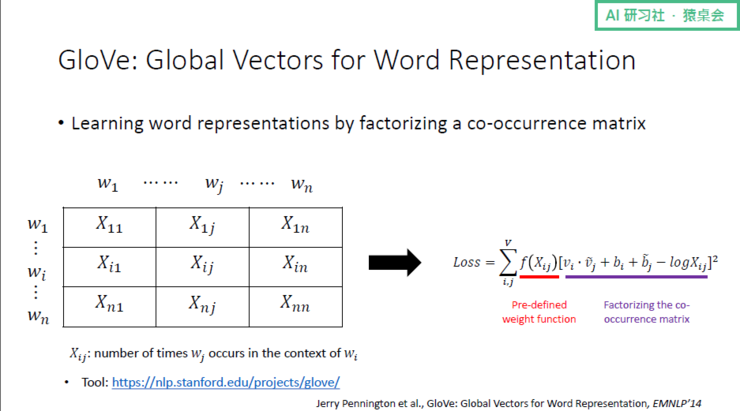

Word Embedding 另一个比较经典的方法是 GloVe:

版权保护: 本文由 沃派博客-沃派网 编辑,转载请保留链接: http://www.bdice.cn/html/23078.html