面部识别技术背后,有什么“肮脏的小秘密”?

雷锋网按,面部识别技术成为整个AI 行业最为常见的技术应用之一;不过,在识别效率越来越高的同时,人们也开始担心面部识别技术发展过程中的隐私安全问题。比如说最近IBM 利用Flickr 下载的图片来进行面部识别训练,就引起了人们的质疑;NBC News 针对此事进行了详细的报道,雷锋网对这篇报道进行了不改变原意的编译。

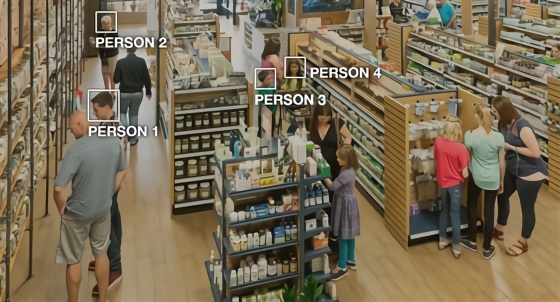

近些年来,面部识别技术得到了长足发展,除了帮你解锁iPhone,还能让执法机关在人山人海中“一眼”就认出犯罪分子,商店甚至用它来识别自己的“死忠”客户。不过,法律专家却警告称,大量未经允许滥用网络照片最终会画地为牢,反过来成为监控你的“帮凶”。

现在的面部识别技术还不完美,它工作时靠的是算法,目标则很简单——认出那张独一无二的脸。

想把这个任务完成好,技术人员就必须提前“喂给”算法“养料”,即天量的面部照片。那么这些照片从哪来呢?当然是互联网。

起初,算法学习的照片都会按照不同的标准进行分类,比如年龄、性别、肤色等,但经过一段时间的学习后,它的能力开始变得有些吓人了,于是法律和人权专家开始大声疾呼,他们担心技术人员对普通人照片的滥用会带来“反噬”效果。

“这是AI 训练数据集背后的肮脏小秘密。技术人员可不管三七二十一,只要能用的照片他们都不放过。”纽约大学法学院教授Jason Schultz 说道。

最近IBM 公司也进了“暴风圈”,今年1 月它们向研究人员分享了自己的数据集,包含了Flickr 上近100 万张照片,虽然IBM 号称此举是为了减少面部识别的偏差。

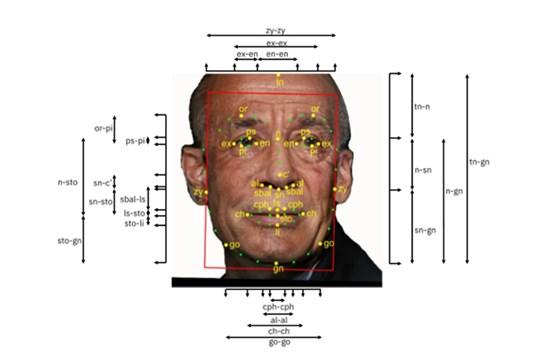

了解真相后的摄影师们不愿意了,因为IBM 在他们的作品上加了各种细节注释,包括面部几何结构、肤色等信息,而这些照片最终可能会成为面部识别算法的“养料”。

“我拍过的人可没想过,自己的照片居然会被用在面部识别算法训练上。”公关经理Greg Peverill-Conti 气愤地说道,他有700 多张照片被收录在了IBM 的“训练数据集”中。“IBM 太草率了吧,它们怎么能不经同意就使用这些照片”。

IBM 公司AI 研究主管John Smith 则表示,公司“致力于保护个人隐私”,如果谁想从数据集中移除照片,尽管联系IBM。

虽然IBM 信誓旦旦的保证Flickr 用户可以随时移除数据集中的照片,但事情哪有那么简单,这本就是个有来无回的“不归路”。因为IBM 需要拍摄者发送想要移除图片的链接(光靠Flickr 账号不管用),而它们却从没分享过到底这个数据集用了谁的Flickr 照片,所以你大概率会被蒙在鼓里。

对于这个数据集,IBM 有自己冠冕堂皇的理由——它将用于学术工作,且担负着让面部识别变得更加公平的重任。当然,在网络照片滥用方面,IBM 并不是独一家,数十家其他研究机构或公司也在采集网络照片训练自己的面部识别系统。

一些法律专家认为,这不仅仅是对数百万人肖像权和隐私权的侵犯,它还加重了人们对面部识别技术的担忧,也许有一天执法部门会让它“双手沾满鲜血”。

面部识别技术的进化历程

面部识别工具刚刚诞生时,研究人员会付钱请人来试验室“帮忙“,这些人拿钱办事,将自己不同姿态和光照角度下的照片留了下来以供研究之用。不过,这样的方案成本高还浪费时间,因此早期的数据集往往只有数百个样本。

进入新世纪后,互联网飞速发展,研究人员突然意识到,面部识别的好时光来了,因为网上有天量的照片可供使用。

“直接打开搜索引擎,输入名人的姓名,然后下载各种360 度无死角的照片既可。”美国国家标准技术局数据集采集人员P. Jonathon Phillips 说道。

随着社交网络的兴盛和自媒体的发展,普通人的照片也突然多了起来。研究人员默认这些照片是对所有人开放的,有时他们甚至会从YouTube 的视频中抓取面部图片。

由于工作的非经营性质,学术人员用起照片来绝对是近水楼台,因为他们能绕过版权问题了,而Flickr 的性质更是让它们成了研究人员绝对的安全之选。

为了保证数据集的多样性,IBM 其实从Flickr 上Down 了超过1 亿张照片,随后又精选了100 万张有注释的面部照片。为了力求精确,它们甚至为这些照片定了200 多种分类标准。

谷歌学术指出,这种研究方法在业内几乎已经是尽人皆知,因为有数百篇学术论文都在靠照片采集来佐证自己的论点,没人敢说自己是完全清白的,或者拿到了授权或同意。因此,面部识别准确性的提高和分析工具的进步主要就是靠这些“野路子”来的照片。

IBM 真没拿面部数据集赚钱?

“要想让面部识别系统超常发挥,训练数据必须足够多样化,而且覆盖范围足够广。”IBM 的John Smith 说道。

版权保护: 本文由 沃派博客-沃派网 编辑,转载请保留链接: http://www.bdice.cn/html/43968.html