这是一份 2018 年 AI/ML 领域年度进展总结,你准备好了吗

原标题:这是一份 2018 年 AI/ML 领域年度进展总结,你准备好了吗

雷锋网 AI 科技评论按,2018 年已到尾声,今年 AI 领域也取得了很多精彩的突破。人们对 AI 的大肆宣扬和恐慌逐渐冷却,更多地关注到具体的问题中。和往年不一样的是,今年深度学习在很多非计算机视觉领域也取得了突破,尤其是在 NLP 领域。同时,今年在框架上的竞争大大升温,Facebook 发布的 Pytorch 1.0 势头强劲,直逼 Google 的 Tensor Flow,微软也发布了 TextWorld 。按照惯例,Curai 的联合创始人兼 CTO Xavier Amatriain 发布了一篇年度总结,雷锋网 AI 科技评论编译整理如下:

对我来说,在每年的这个时候总结 ML 的进展已经成为一种传统(例如,我去年就在 Quora 上回答过这个问题)。一如既往,这个总结必然会偏向于我自己感兴趣的领域。

如果要我把 2018 年机器学习进展的主要亮点总结成几个标题,那就是:

对 AI 的大肆宣扬和恐慌逐渐冷却;

更多地关注具体问题,如公平性、可解释性或因果性;

深度学习将持续下去,并且在实践中不仅仅可以用来对图像分类(特别是对 NLP 也非常有用);

AI 框架方面的竞争正在升温,如果你不想默默无闻,你最好发布一些自己的框架。

让我们来看看具体是怎么样的。

如果说 2017 年对人工智能的大肆宣扬和恐慌都达到了极点,那么 2018 年似乎就是我们开始冷静下来的一年。虽然有些人一直在散布他们对于人工智能的恐惧情绪,但与此同时,媒体和其他人似乎已经同意这样的观点,即虽然自动驾驶和类似的技术正在向我们走来,但它们不会在明天发生。尽管如此,仍然有声音认为我们应该规范人工智能,而不是集中于控制其结果。

不过,很高兴地看到,今年的人们关注的重点似乎已经转移到了可以处理的更具体的问题上。例如,关于公平性的讨论很多,而且关于这个话题的会议不止 1 次(例如 FATML 和 ACM FAT),甚至还有一些在线课程也在是关于这个话题的,比如 Google 教人们认识机器学习中的公平性的课程。

顺着这条思路,今年已经深入讨论的其他问题有可解释性、解释性和因果性。因果关系似乎回到了聚光灯下,这源于 Judea Pearl 的《The Book of Why》的出版。作者不仅决定写他的第一本「普通人能够读懂」的书,而且他还利用 Twitter 来推广关于因果关系的讨论。事实上,甚至大众媒体都认为这是对现有 AI 方法的「挑战」(例如,你可以看看《机器学习的先驱如何成为最尖锐的批评者之一》这篇文章。实际上,甚至 ACM Recsys 大会上的最佳论文奖也授予了一篇相关论文,该论文讨论了如何嵌入因果关系的问题(参见《Causal Embeddings for Recommendations》)。尽管如此,许多作家认为因果关系在某种程度上只是一种理论,我们应该关注更具体的问题。

Judea Pearl 的书

作为最通用的 AI 范例,深度学习仍然存在很多问题,很显然,深度学习不会止步于当前,就它所能提供的东西而言,它还远远没有达到高峰。更具体地说,今年深度学习方法在从语言到医疗保健等不同于计算机视觉的领域取得了前所未有的成功。

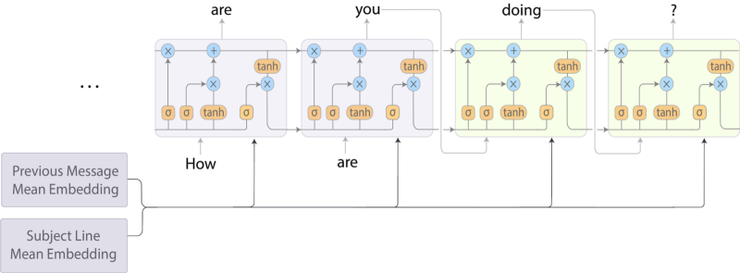

事实上,今年深度学习最有趣的进展可能出现在 NLP 领域。如果要我选出今年最令人印象深刻的 AI 应用程序,它们都将是 NLP 应用程序(并且都来自于 Google)。第一个是 Google 发布的超级有用的 smart compose,第二个是他们的 Duplex 对话系统。

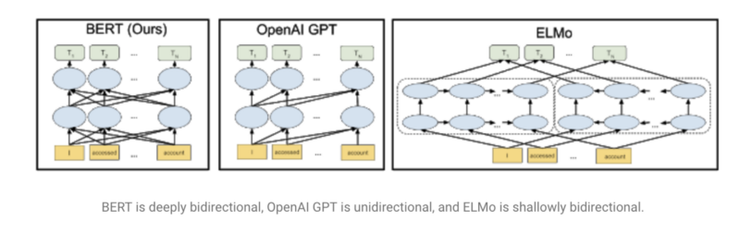

使用语言模型的想法加速了这些进步,这种想法在今年 Fast.ai 的 UMLFit 课程里面普及。随后我们看到了其他改进的方法,比如 Allen 的 ELMO,Open AI』s transformers,或最近击败了很多 SOTA 的 Google 的 BERT。这些模型被描述为「Imagenet moment for NLP」,因为它们提供了随时可用的预训练好的通用的模型,这些模型还可以针对特定任务进行微调。除了语言模型之外,还有许多其他有趣的进步,比如 Facebook 的多语言嵌入。值得注意的是,我们还看到这些和其他方法被集成到更通用的 NLP 框架(比如 AllenNLP 或 Zalando) 的 FLAIR 中的速度非常快。

版权保护: 本文由 沃派博客-沃派网 编辑,转载请保留链接: http://www.bdice.cn/html/19517.html