让机器看懂世界,诠视科技专注以vSLAM+AI技术赋能XR与机器人环境感知

2016年曾是AR/VR/MR行业的元年,同样遵循Hype Circle(技术成熟度曲线),整个行业历经繁荣、泡沫、低谷,直至近年复苏。尤其随着5G的推进,最直接的影响便是带宽。高带宽、低延时对于新一代机器视觉和AI技术的空间行业,尤其在空间交互这一领域意义重大,软硬件设备的开发者渐渐开始依照终端消费者的需求来开发产品。

有一个说法是,在人类认知能力倍增的human2.0时代,也是这个行业内的公司共同想要达到的一个目标:让机器看懂世界,让人类获得超能。

在技术高速迭代的过程中,计算机视觉的准确率和识别率被广泛用于机器人,无人驾驶等虚拟现实领域。尤其在中国市场中,扫地机器人已经被广泛接受,占整体家用服务机器市场的60%,在沿海城市的产品渗透率为5%。据Tractica预测,到2025年,全球计算机视觉软件、硬件和服务收入将增长到262亿美元。业内对未来的一个基本判断是,未来一定是“移动式”的,而这对于“未知位置的定位与追踪”的要求必然高了不少。

其中vSLAM因为信息量大,适用范围广等优点受到广泛关注,它也是高竞争门槛的基础核心视觉部件。

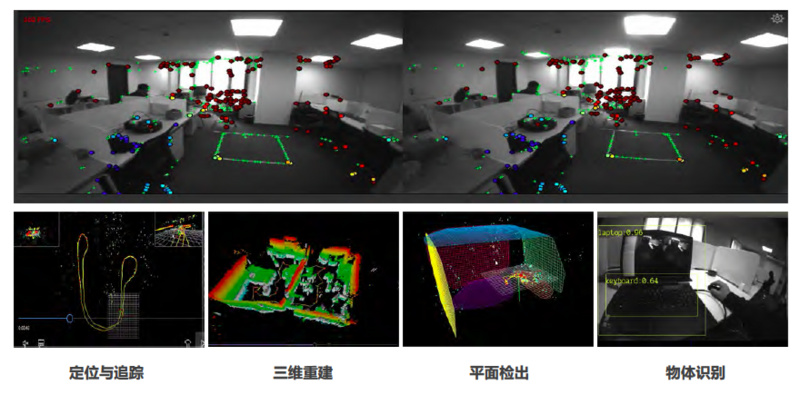

SLAM(simultaneous localization and mapping),即同时定位与建图。这是在定位的基础上,将观测数据进行融合的过程。简单举例来说,机器人从未知环境的未知地点出发,在运动过程中通过重复观测到的地图特征以定位自身位置,并以此构建地图,从而达到同时定位和地图构建的目的。

背后的原理与GPS定位系统,WIFI定位都有一定相似之处,但前者定位方案在精度或价格方面都无法满足常见的SLAM应用,其关键的技术壁垒在于算法和集成,目前全球范围内只有微软、高通等掌握核心技术,诠视科技CEO林瓊告诉36氪,“与高通所面对的客户群体不同,我们瞄准的是长尾市场。”

诠视科技是一家专注机器视觉,以vSLAM+AI技术赋能XR与机器人环境感知的公司。目前,该公司与Intel建立了战略合作伙伴关系,在Intel Movidius平台的授权和支持下研发AI,与vSLAM协同工作。林瓊介绍,“对位置的追踪是强交互的场景,对于延迟极其敏感。我们要在边缘计算上实现这个功能,边缘计算可以使交互信息无需经历传输到控制器这一过程,直接输出6DOF信息,水平分辨率和追踪精度高达毫米级别。”随着AR/VR/MR行业的发展,去年推出的Magic Leap分体式产品已然成为行业内部某种形态上的分水岭。自此,硬件从一体式变为分体式,目前各大手机厂商更是在布局一种新的产品形态,“未来手机将可以成为控制器。”随着传感器技术的发展,算法的进步,SLAM技术本身也进入了一个从算法到产品过渡的阶段。

传统行业中比较常见的传感器便是激光雷达(单线、多线,能够获得对应点的深度信息),诠视要做的,不是替代激光雷达,而是将vSLAM与激光雷达做更好的融合 —— vSLAM主要是通过摄像头来采集数据信息,显然摄像头的成本要比激光雷达低的多。然而后者在更高精度的测量方面,尤其在障碍点的角度和距离测量上,确实更有优势。

梳理AR/VR的技术迭代历程,从传感、交互、到呈现 —— 刚开始大家的目标只是速度不得低于90帧;呈现的分辨率达到720p/1080p;交互时降低出现晕眩感的频次等。发展至今,林瓊甚至在2019年的CES展上发现了单眼8K的产品。“我们团队当时的目标就是一定要做到超高速帧率,这对算法的要求极高。为了避免眩晕感,AR/VR设备的总体延迟不能超过20毫秒。”换句话说,林瓊的团队要做到的是,“把追踪和模组定位分离出来,使得对与之配套的单元子系统的要求无需太高,举个例子就是华为有中高低端的芯片,尤其在未来AR的设备可能成为手机附件的时候,这对于使用时的‘一致性’的要求特别高,必须中高低端都可以满足匹配的需求。”诠视科技在端面上实现环境感知的vSLAM技术与环境认知的AI技术的有机融合,属于业内首创。其也在CES 2019上获Innovation Award(共45家),并以超高速双目vSLAM传感器入选工信部2018年物联网关键技术突破。

作为专注于AR/MR、机器人、无人机等领域的超高速(100fps)vSLAM视觉导航技术方的提供方,诠视科技研发出的端处理双目视觉6DOF位置追踪模组精度极高。所谓6DOF(6自由度),主要与物体在空间内的运动相关,可以理解为物体移动的不同基本方式。“传统有3个自由度,但6个自由度才会有沉浸感,也更真实。这也是未知信息感知的重要度。”基于超高速vSLAM和深度学习解决方案,诠视科技可以赋予机器即插即用的6DOF空间感知、定位和追踪能力。

版权保护: 本文由 沃派博客-沃派网 编辑,转载请保留链接: http://www.bdice.cn/html/27920.html