神经网络如何完成表征?

翻译 | 小冷、jinlilei 校对 | 酱番梨

整理 | 菠萝妹

原文链接:

我们了解神经网络以及它们从数据科学到计算机视觉的多个领域中的无数成就。众所周知,它们在解决有关泛化性方面的复杂任务中表现良好。从数学上讲,他们非常擅长近似任何的复杂函数。让我们形象化地理解这种近似概念,而不是前向和后向传播方法中的最小化预测误差。假设你了解前向和后向传播的一点基础,其旨在借助梯度和网络中的错误传播来近似函数。让我们通过另一种视觉解释来理解神经网络的近似能力。其中涉及基础数学和图形分析。

在数学上,我们将研究给定神经网络的表征能力,以便提供近似的函数。

表征能力与神经网络的能力相关,神经网络会为特定实例分配适当标签并为该类创建明确定义的准确决策边界。在本文中,我们将探索一种视觉方法,用于更多地了解神经网络的近似特性,这与神经网络的表征能力直接相关。

旅程

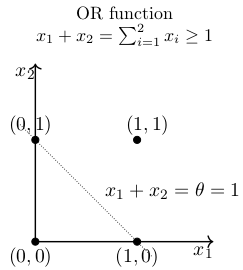

它始于MP 神经元模型,它是一个非常简化的神经元模型。通过非常简单地概念,神经元激活与否取决于某一阈值,即只有当其输入总和大于给定函数的阈值时,神经元才被激活,否则神经元不会发生输出信号。为了检查它的表征能力,让我们看它的几何解释。首先进行2-D分析,使用2个输入来近似OR函数,然后使用3个输入进行3-D分析。

对于二维坐标系中的分离,需要一条分类直线。神经元会向直线右侧的点发射信号。因此,就创建出了分离边界。

对于三维坐标系中的分离,需要一个分类面。神经元会向这个面上方的所有的点发射信号。

因此,M-P神经元模型可用于表示任何线性可分的布尔函数。此外,我们可以看到一个严格的分界规则,而不是一个渐进的决策边界,任何略高于分离边界的为1,下面的正好为0。神经元触发了和阶梯函数一样的行为。感知器的每个输入都带有权重,但仍然存在严格的划分,从而实现了更大的灵活性。但是,上述机制不能处理非线性可分函数。一个非常简单的例子比如异或(XOR,两个输入如果相同,输出为0;两个输入如果是不同,输出为1),就无法用一条直线来分割开来,想象一下在这个函数的2维平面上绘制一条分离线。让感知器处理异或这样线性不可分问题,它就无能为力了。大多数数据与异或非常相似,本质上是线性不可分的。

因此,需要先进的计算模型,如当前需要为这些函数创建分离边界的神经网络。只需看一个包含一个隐藏层和一些复制异或函数的预定义权重的基本图。

图:红线表示权重为-1,蓝色表示权重为+1

异或函数实现的条件:w1 < pan>

记住:具有n个输入的任何布尔函数都可以由感知器网络表示,感知器网络包含具有2 ^ n个感知器的1个隐藏层和包含1个感知器的1个输出层。这是充分不必要条件。

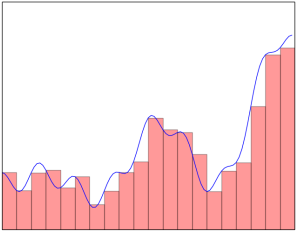

通过我们对具有阶梯函数(如近似)的单个隐藏层网络的分析。它的严格判断标准与阶梯函数一样具有局限性。让我们深入研究具有S形非线性逼近函数的多层深度网络。

时过境迁经过sigmoid激活的神经元具有非常强的表征能力。具有一个单隐层的多层神经元网络可以近似任意连续函数,并达到任何想达到的精度。

数学上,可以得到这样的证明:对于任意函数f(x):R(n)→ R(m),我们总可以找到一个拥有(单或多)隐层的神经网络,其输出g(x)满足 |g(x)-f(x)| < Θ.

上述的说法在自然界中是非常的。因为它意味着,我们可以用一个给定的神经网络去近似任意函数。从数学角度来讲,万能近似定理(universal approximation theorem)指出,在对激活函数温和的假设下,一个包含有限神经元的单隐层自编码网络可以近似R(n)紧致子集上的任意连续函数。这个理论因此也就说明,在给定合适参数下,简单的神经网络可以代表各种各样的函数。然而,它并没有涉及到那些参数的算法收敛性。收敛是和前馈、后馈算法相关的。下面让我们通过一种直观的解释方式来理解上述理论,它是神经网络学习的基础。

版权保护: 本文由 沃派博客-沃派网 编辑,转载请保留链接: http://www.bdice.cn/html/4856.html

- 上一篇:2020款全新混动丰田卡罗拉将正式亮相

- 下一篇:独角兽公司惊人发展背后的分析